Die Politik will Kinder vor Social-Media-Risiken schützen – nach Vorstellung der Missbrauchsbeauftragen Kerstin Claus soll dies auch für Gaming-Plattformen gelten.

In die Debatte um eine Regulierung von sozialen Netzwerken ist erkennbar Bewegung gekommen: Ein SPD-Positionspapier fordert ein vollständiges Social-Media-Verbot für Kinder bis 14 Jahren – im Vorfeld des CDU-Parteitags am kommenden Wochenende mehren sich zudem prominente Stimmen in der Union, die ebenfalls Handlungsbedarf sehen. So plädiert NRW-Ministerpräsident Hendrik Wüst für eine wirksame Altersbeschränkung – schließlich seien auch Alkohol, Tabak und Glücksspiel staatlicherseits reguliert.

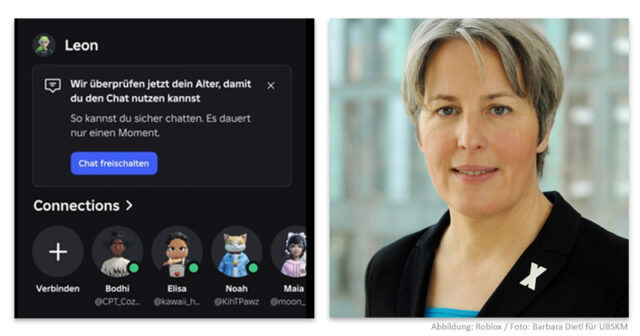

Analog zum bereits bestehenden Social-Media-Verbot in Australien geht es im Kern um Plattformen wie Tik-Tok, Facebook, X, Reddit Snapchat, Reddit, Twitch oder Instagram. Die geplante Regulierung hat erkennbar zu hektischer Betriebsamkeit bei einzelnen Anbietern geführt: So fordert Discord einen Altersnachweis von Nutzern – standardmäßig gilt „teen by default“. Wer auf alle Kanäle und Inhalte zugreifen will, muss sich per Kamera ausweisen.

Social-Media-Verbot: Missbrauchs-Beauftragte wirbt für Einbeziehung von Gaming-Plattformen

Eine weitere Facette kommt nun von der unabhängigen Beauftragen der Bundesregierung gegen sexuellen Missbrauch von Kindern und Jugendlichen (UBSMK): Kerstin Claus begrüßt eine differenzierte Ausgestaltung der Altersgrenzen, wie sie etwa die SPD vorschlägt.

Darüber hinaus hält es Claus für geboten, auch Online-Spiele zu berücksichtigen. Gegenüber der Mediengruppe Bayern verwies sie auf die „erheblichen Risiken“, die auf Gaming-Plattformen entstünden: Die Chat-Funktionen bergen die selben Gefahren wie soziale Medien: „Hier darf es keine Schutzlücke geben“, so Claus.

Auf Anfrage von GamesWirtschaft betont eine Sprecherin der Missbrauchs-Beauftragten, dass es ein ganzes Maßnahmen-Bündel braucht, um dem Problem zu begegnen – angefangen von einer besseren Abstimmung zwischen Bund und Ländern bis hin zu einer wirksamen Strafverfolgung. Neben der Politik komme auch den Eltern und der Gesellschaft besondere Verantwortung zu.

Der Digital Service Act (DSA) verpflichtet die Anbieter großer Plattformen schon jetzt, geeignete und verhältnismäßige Maßnahmen zum Schutz von Kindern und Jugendlichen zu greifen. Was im Einzelfall als „geeignet“ und „verhältnismäßig“ gilt, obliegt den Betreibern – was die uneinheitliche Umsetzung erklärt.

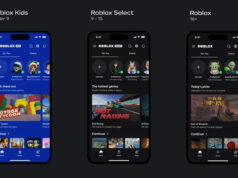

Weiterhin im Fokus der Kritik stehen Plattformen wie Roblox: Der US-Konzern hat die Sicherheitsmaßnahmen in mehreren Schritten nach massiver Kritik von Jugendschützern nachgeschärft. In Deutschland wurde die Altersfreigabe vor einem Jahr angehoben: Roblox ist offiziell erst ab 16 Jahren freigegeben.

Mit Blick auf den anhaltenden Druck von Bundesregierung und Ländern spricht viel dafür, dass sich schon in Kürze ein Kompromiss für eine stärkere Regulierung sozialer Netzwerke abzeichnet – die sich möglicherweise auch auf Games-Plattformen erstreckt. Überwältigende 93 Prozent der diesjährigen GamesWirtschaftsWeisen halten dieses Szenario für unwahrscheinlich. (pf)

Hallo, Discord hat da aber ein Update nachgereicht.

https://discord.com/safety/how-discord-is-building-safer-experiences-for-teens

Zitat: For the majority of adult users, we will be able to confirm your age group using information we already have. We use age prediction to determine, with high confidence, when a user is an adult. This allows many adults to access age-appropriate features without completing an explicit age check.

m.f.g.

Einzelne Funktionen sind aber offenbar weiterhin eingeschränkt – etwa mit Blick auf das gesonderte Postfach, in das ‚fremde‘ Nachrichten umgeleitet werden. Die konkrete Ausgestaltung wird man dann ab März sehen. Danke für den Hinweis.

Kommentarfunktion ist geschlossen.